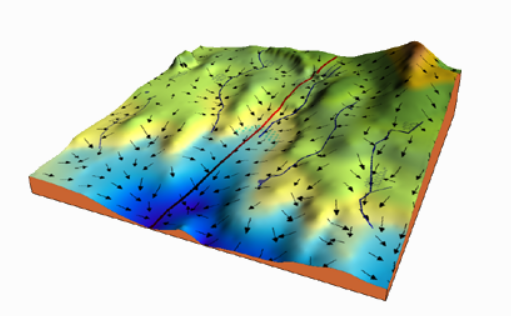

안녕하세요. Gradient Descent에 대해서 공부하기위해서 조사한 자료를 요약하고자 합니다. Gradient Descent Gradient descent는 한국말로 경사하강법이라고 불립니다. 머신러닝에서 Gradient Descent는 모델의 파라미터값들을 업데이트하기 위해서 사용됩니다. 어떤방식으로 파라미터값들을 업데이트 하는지 설명해드리겠습니다. Introduction 예시를 들어볼게요. 다음과 같이 3차원 그래프 그림이 있다고 가정을 해볼게요. 여기서 우리가 원하는 것은 오른쪽 위에보이는 높은 지형(높은 값을 가진 지형이라고 가정할게요) 에서 가장 낮은 지형(진한 파랑 -> 낮은 값을 가지고 있는 지형)으로 가고자 하는 것으로 하겠습니다. 그리고 그림에서 화살표는 해당 위치에서 음의 기울기방..